编者按:这篇博文由 Matt Carey 撰写,他是 Genoss 的构建者之一。我们也在我们的博客上分享这篇文章,因为我们听到很多人不想被锁定在单一模型中。我们认为像 Genoss 这样为互操作性提供清晰界面的工具将帮助更多构建者快速将强大的应用程序投入生产。我们也对它与 LangSmith 的集成感到非常兴奋,它可以实现轻松的调试、日志记录、监控和可观察性!

隆重推出 Genoss GPT:通过 Genoss 模型网关实现一行 GPT 应用程序的可移植性。

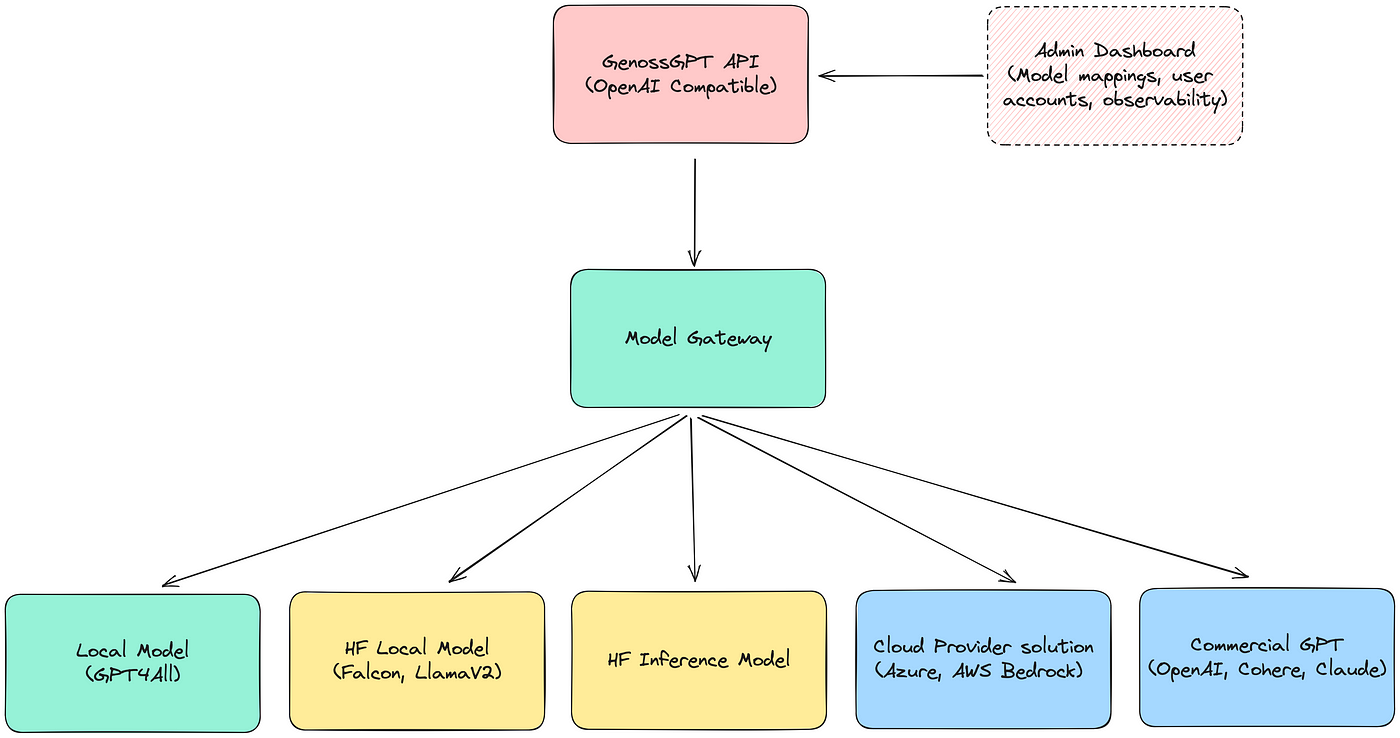

TL;DR:GenossGPT 提供了一个通用接口,用于与 GPT 模型交互,简化了在您的 GenAI 驱动的应用程序中集成和切换模型的任务。它使企业能够控制其模型的使用,同时利用 LangSmith 在生产中提供增强的可观察性和分析。

生成式 AI 领域的开发持续升温,大型语言模型 (LLM) 的用途不断扩展。这些用途涵盖个人助理、文档检索以及图像和文本生成等不同领域。像 ChatGPT 这样的突破性应用程序为公司深入该领域并开始使用这项技术进行构建铺平了道路。

大型企业正在构建自己的模型,例如 AWS 的 Titan 模型、Meta 新发布的 Llama 2 以及微软与 OpenAI 和 Meta 的合作,这表明该领域有大量的投资。

像 Hugging Face 这样的独角兽初创公司,以 40 亿美元估值筹集资金,已经主导了开源领域,并允许任何人轻松部署模型。大学将继续突破预算内可能的界限,这些创新将反馈到开源项目中。然而,由于成本高昂,小型公司不太可能与大型科技巨头在从头开始构建生产级 LLM 方面竞争。

像 LangChain 这样的生态系统为开发人员与这些第三方 LLM 或通常称为基础模型进行交互提供了一组有用的实用程序。LangChain 类帮助开发人员利用具有 I/O 和内存的模型,以及提供模型链来完成特定任务,例如文档检索。此外,LangChain 建立了一个标准词汇表,引入了诸如“RetrievalChain”和“MemoryStore”之类的术语,这些术语在生态系统中具有明确的含义,从而简化了 AI 工程师之间的讨论。

集成问题

在旨在促进与 LLM 提供商集成的当前工具中,仍然存在一个明显的差距。随着更新和改进模型的推出以及技术的进步,工程师希望能够自由地使用这些模型快速实现新功能。

LangChain 为大量模型(例如 OpenAI 和 Hugging Face)提供了基于通用 LLM 类的类。但是,它需要为每个提供商使用不同的类。这些类具有各种方法和属性,尽管您可能希望它们是直接即插即用的,但实际的解决方案很少如此简单。

模型流式传输和嵌套链等因素进一步使问题复杂化。LangChain 在构建可组合部件(例如 VectorStores、DocumentLoaders 和 Retrievers)之间的互操作性方面做得非常出色,但我们需要改进开发人员在 LLM 模型之间切换时的体验。

Genoss 是解决方案

Genoss 是一个由 LangChain 驱动的模型网关。它将调用任何受支持的 LLM 的过程标准化为一个统一的接口,与 OpenAI API 规范兼容。只需将您的基本 URL 更改为您的 Genoss 端点,您就可以触手可及任何 LLM 模型的强大功能。与任何支持 OpenAI 接口的第三方工具的直接集成都可以开箱即用。

Genoss 为您完成了繁重的工作,为您提供了一个单一的、有凝聚力的接口,用于与跨多个提供商的 Completions 和 Embeddings 模型进行交互。您只需简单更改模型名称,即可在本地开源模型、OpenAI 模型、AWS Bedrock 模型或任何 Hugging Face 模型之间切换。

在企业环境中使用 Genoss 时,管理员可以通过仪表板上的单个更改来更新模型(即将推出)。无需更新任何应用程序代码以指向新的提供商,映射完全由 Genoss 处理。这对于为不同任务甚至用户层使用不同模型的应用程序非常有用。您的应用程序的付费用户可以访问多种模型选择,这些模型具有不同的优势,例如增强的隐私或使用特定知识进行微调,而演示用户将使用通用且更便宜的模型。

生产中的使用

Genoss 是开源的,可以通过托管版本免费使用,也可以在您自己的基础设施上自行托管。将 Genoss 视为 LLM 应用程序的 Supabase。它使开发人员能够使用相同的基础设施和技术堆栈,直接从周末的业余项目过渡到生产。

Genoss 利用了 LangChain 的新工具 LangSmith。LangSmith 在工作流程的每个阶段提供模型输入和输出的可观察性、调试和测试。可以对 LLM 调用的分析进行执行,以帮助提高模型和提示的使用率和有效性。这使公司能够比以往任何时候都更有信心地在生产中运行基于 LLM 的工作流程,并对其模型及其输出充满信心。

当使用 Genoss 作为您的模型网关时,LangSmith 会自动设置并准备就绪。公司还可以使用 LangSmith 来跟踪令牌使用情况、管理 LLM 调用的成本,并直接从 Genoss 控制台密切关注延迟。

结论

模型接口之间缺乏一致性使得使用 LLM 进行构建变得不必要地复杂。由于云提供商、商业模型和开源模型在标准接口上未对齐,因此 Genoss 提供了接口统一。Genoss 降低了开始构建的开发人员以及扩展利用生成式 AI 力量的组织的学习曲线。

鉴于 LLM 快速发展的步伐,开发人员将使用 Genoss 来测试最新的模型,试验微调并在本地运行私有模型。企业将使用 Genoss 来控制其用户在内部和生产应用程序中的模型使用情况,同时利用 LangSmith 进行可观察性、调试和测试。

在此处查找 Genoss 的代码存储库。我们期待看到您将使用它构建什么。

感谢团队 Stan Girard、Maxime Thoosen、Arnault Chazareix 的辛勤工作。