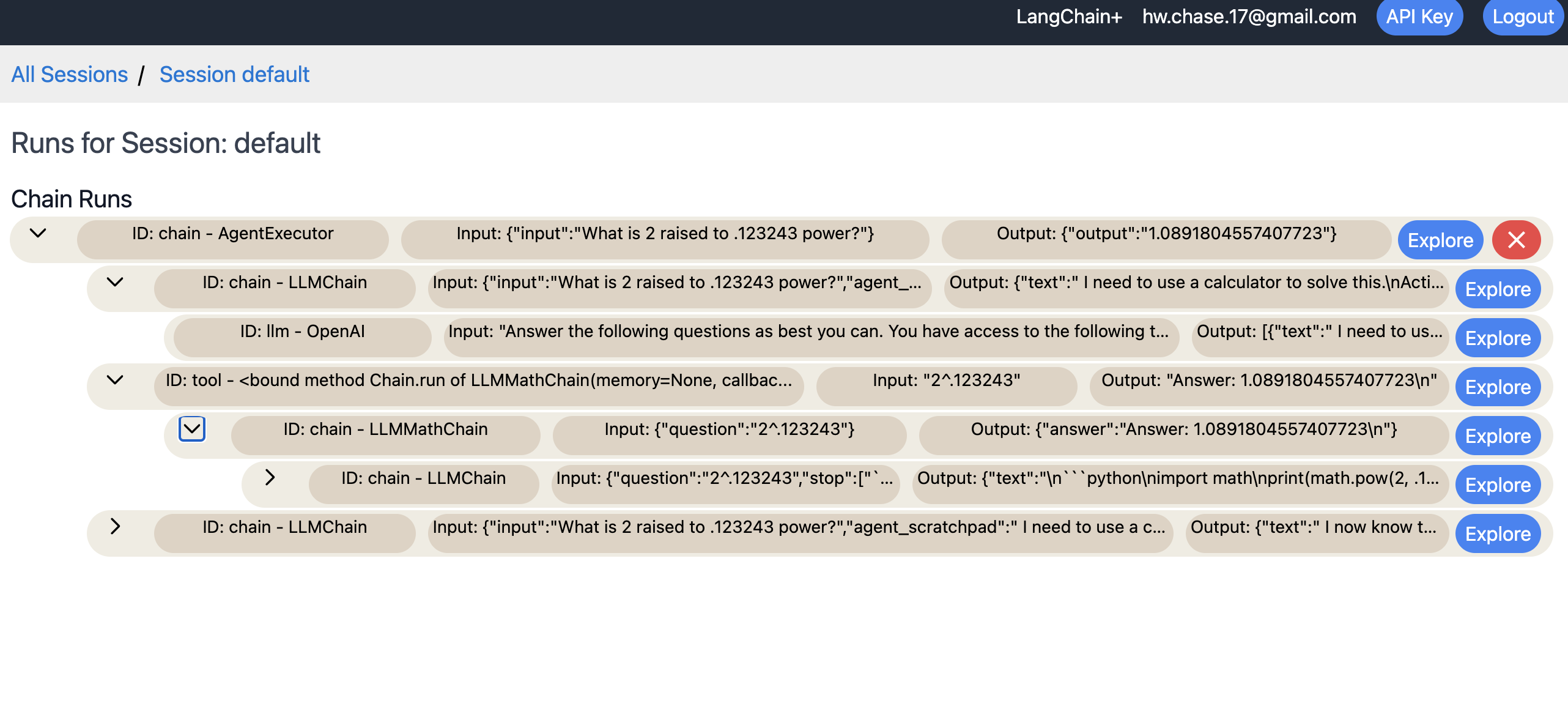

我们很高兴宣布 LangChain 中原生追踪支持的发布!通过在您的 LangChain 运行中启用追踪,您将能够更有效地可视化、逐步查看和调试您的链和代理。

动机

推理您的链和代理执行对于故障排除和调试非常重要。然而,对于复杂的链和代理来说,这可能很困难,原因有很多

- 步骤可能很多,使得难以跟踪所有步骤

- 步骤的顺序可能不是固定的,并且可能因用户输入而异

- 每个阶段的输入/输出可能很长,值得更详细的检查

链或代理的每个步骤也可能涉及嵌套——例如,代理可能调用一个工具,该工具使用 LLMMathChain,后者使用 LLMChain,然后调用 LLM。如果您注意到来自顶级代理运行的奇怪或不正确的输出,则很难确定它究竟是在执行的哪个环节引入的。

追踪通过允许您清楚地看到特定链或代理运行中涉及的每个 LangChain 原语的输入和输出,并按照它们被调用的顺序,从而解决了这个问题。

在 LLM 组合的追踪和可视化方面已经有一些很棒的工作(参见 ICE 和 langchain-visualizer),我们现在很高兴将追踪原生集成到 LangChain 中。我们希望在不久的将来发布基于追踪的新的和令人兴奋的功能。

用法

作为起点,我们允许所有人通过使用 docker-compose 启动的本地托管设置,在他们的 LangChain 组合中利用追踪。我们还在向一小部分初始用户推出托管版本。如果您有兴趣获得访问权限,请填写此表格。

有关如何入门的完整技术文档,请参阅此处。

我们希望不断迭代改进,使其尽可能有用。如有任何反馈,请联系我们!

下一步

我们才刚刚开始进行追踪和附加功能。未来我们希望添加

- UI 改进

- 更好的追踪过滤和分组

- 记录每次运行的完整序列化

LLM和Chain - 我们仍在充实的其他令人兴奋的功能 ;)